さていよいよこの連載も最終回となりました。ここまで7回にわたって撮影にまつわる話をいろいろと書いてきましたが、今回はその補足と細々とした問題を取り上げてみたいと思います。最終回としてはあまり派手な話になりませんが、撮影というのは元々それだけ地味なもの、という事で最後までお付き合いください。

前回の美術との連携の話題で貼り込み素材について触れましたが、現在、「貼り込み」という作業はとても頻度が多くなっています。デジタル化以降、画面全体の密度が上がってきたために以前ならセル表現ですんでいたものにも密度を持たせるため、動く部分にも美術などで描かれた素材の貼り込みを用いるのです。画面上のサイズが小さければ色指定で対応可能なものもありますが、素材が仕上げに届くタイミングなどもあって、最終工程の撮影で作業するケースが多くなります。張り込みは基本的にはいくつかの変形機能を使用します。単純なパース変化であればコーナーピンと呼ばれる画面の四隅を起点に画面を歪める手法、曲線的に変形させる場合はメッシュワープやベジェワープという画面を曲げる機能を使用します。

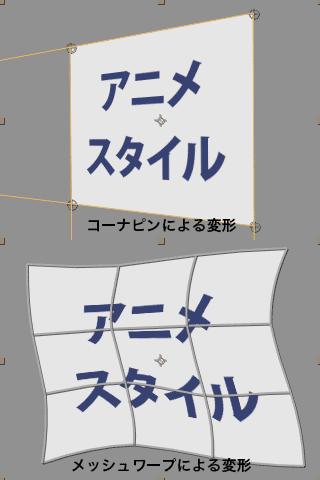

前回の美術との連携の話題で貼り込み素材について触れましたが、現在、「貼り込み」という作業はとても頻度が多くなっています。デジタル化以降、画面全体の密度が上がってきたために以前ならセル表現ですんでいたものにも密度を持たせるため、動く部分にも美術などで描かれた素材の貼り込みを用いるのです。画面上のサイズが小さければ色指定で対応可能なものもありますが、素材が仕上げに届くタイミングなどもあって、最終工程の撮影で作業するケースが多くなります。張り込みは基本的にはいくつかの変形機能を使用します。単純なパース変化であればコーナーピンと呼ばれる画面の四隅を起点に画面を歪める手法、曲線的に変形させる場合はメッシュワープやベジェワープという画面を曲げる機能を使用します。

コーナーピンは直線的な変形しかできないので、モニター画面やドアなど平面のものに用います。単純な形状であれば厚みのあるものも表面と側面を別々に貼り込むことで表現可能です。

メッシュワープは曲面として扱えるので、本や新聞紙、ボトル類や服の模様などに用いられます。メッシュの密度は変えることができます。ただ、いくつかの交点を動かして曲げるため、そうした制御点が多くなると作業が大変になりますし、不用意な伸びが不自然な動きを生みやすいので、なるべく少ない交点ですます方が効率的です。

貼りこみ素材は基本的に矩形のものしか扱えないので、基本的には正面から見た形で作られます。間違って歪んだ形で描かれたものが上がってきた場合は、一度矩形に戻して貼らなくてはなりません。矩形で対応できない特殊な場合は、外部ツールを用いて変形、張り込みを行います。

『ハウルの動く城』ではElasticRealityというソフトを使い、城の足の部分だけですが、多くのカットで作画したセルへの張り込みを行って質感を表現しています。後半の城の崩壊シーンでも貼りこみが大量に用いられています。いずれの場合も、全てのコマを追いかけてプロットする事になりますので、非常に労力がかかります。長くて複雑な動きだと不自然にならないように時間をかけて作業しなければなりません。

最近は貼りこみをどこまで撮影でやるべきなのかという声も聞いたりします。がんばれば回転するようなものも作れなくはないですが、元は平面から作るものなので表現に限界もあり、複雑になってくると手間をかけるより3Dを用いたマッピングを使用します。

貼り込みに関連して取り上げたいのが、文字情報についてです。張り込まれる素材には文章のものも多いのですが、最近の高解像度化により、可読性が高まっています。そのため現場でも様々な対応が取られるようになりました。

まず、担当の演出家がきちんとした内容のものを用意し、モーショングラフィックス担当も理屈を用意するようになっています。最初に、全く架空の文字デザインを用意し、数値や50音に振り分けて使う、なんて事も行われます。かつて商品にもなった、ゼントラーディ文字みたいなものですね。撮影時のぼかしやエフェクトで読めないように加工してしまう手もありますが、それでも読み取られる事があるので注意が必要です(ファンの執念には驚かされます)。パブリックドメインや完全にランダムな文字列なら問題ありませんが、実在の書物などを使用する場合は当然著作権についての配慮が必要です。最近では宗教やポリティカルコレクトネスについても配慮が求められるところでしょう。

文字に関する話題では、書体の問題もあります。張り込みが増えた関係で使用される書体(フォント)の種類も多くなりました。当然ながら、商業利用可能なものを使うことになりますが、メーカーごとに使用規定が違うので、注意が必要です。最近は初めからメーカーと包括契約を結ぶ事も多くなりました。こういった場合は、スタッフロールにフォント協力といった名称でフォントメーカーの社名がクレジットされています。

エフェクトの話題でボケについて取り上げました。アニメでは、他にもボケを使った表現があります。モーションブラーと言って、動きの速さを表現するものです。レンズブラーはレンズを通した光学現象を再現したものですが、こちらはフィルムやセンサーに捉えられた状態を再現したものです。動きが早すぎて記録媒体上ではブレてしまうという表現で、頻繁に使用されます。分かりやすいのはアクションシーンですが、画面からフレームアウトする寸前などに適用してカメラ近くで大きな動きがあったことを表現する、なんていう使われ方もあります。フレームアウトする場合、画が目に残りやすいので、それを緩和する効果もあるのです。動きの早い背景に、奥行表現とはまた別の効果を狙って使われる事もあります。

エフェクトの話題でボケについて取り上げました。アニメでは、他にもボケを使った表現があります。モーションブラーと言って、動きの速さを表現するものです。レンズブラーはレンズを通した光学現象を再現したものですが、こちらはフィルムやセンサーに捉えられた状態を再現したものです。動きが早すぎて記録媒体上ではブレてしまうという表現で、頻繁に使用されます。分かりやすいのはアクションシーンですが、画面からフレームアウトする寸前などに適用してカメラ近くで大きな動きがあったことを表現する、なんていう使われ方もあります。フレームアウトする場合、画が目に残りやすいので、それを緩和する効果もあるのです。動きの早い背景に、奥行表現とはまた別の効果を狙って使われる事もあります。

画面全体にかける事もあれば、ブラーをかけたい部分だけマスクして適用する事もあります。さらに、前後の動きを検出して動きに合わせたブラーを自動的に作り出すプラグインもあります。演出の指定があれば入れざるを得ないのですが、何事も過ぎたるは及ばざるが如しで、やりすぎはアニメーターの腕の見せどころである動きの表現を阻害しかねません。個人的には、多用するのもいかがなものかと思っています。

やりすぎと言えば、背景に対するぼかしの適用や、画面に入れる環境光・フレアによるセル色への影響なども悩ましいところです。はじめからぼかす事が前提になっていれば、了解も得やすいでしょうが、撮影段階で入れることが決まる場合も多く、ほとんどぼかしたりする事になるとさすがに気が引けます。とはいえ、きちんと描かれた背景でないと、これまたきちんとしたボケができないという問題もあって難しい。色指定に関しても同様です。シーンや背景に対してマッチした色指定をしても、背景をぼかせば、印象も厳密には変わるでしょうし、さらに上から光を足すとなるとセルの色も大幅に変わって見えてしまいます。打ち合わせで最終画面がどうなるかしっかりと全体のコンセンサスを得ておけば、こういった問題に頭を悩ますことも少なくなるとは思いますが……。

色の話題と言えば、現在のアニメーションの現場では、ほとんど24ビットカラーで作業しています。これは一般に言われるフルカラー1670万色にあたります。色の3原色RGBそれぞれに、8ビット256階調を割り当てて、256の3乗で1677万7216色を表示します(残りの8ビットはマスク用です)。AfterEffectsやPhotoshopでは8ビットカラーとチャンネルごとの値で表しています。セルや背景などもこの色数の中で作成されています。ただし撮影時にはさらに多いRGB各16ビットで計算を行います。これによって各チャンネル6万5536階調を使用できるのですが、AfterEffectsやPhotoshopは15ビットで処理するので、実際には3万2768階調になります。広い階調で計算することでグラデーションやボケを滑らかに表現することができます。8ビットしか使えなかった時代には、グラデーションの階調不足から、トーンジャンプと言って明るさが急激に変化して見える現象や、マッハバンドという一種の錯視による階調の境界が強調されて見える現象が起きたのですが、最近はだいぶ緩和されています。とはいえ、TVの場合は最終的に8ビットの画像として描き出す事が多いために、表現に階調が必要な暗部には特に注意が必要です。階調不足を軽減する方法としてはノイズや拡散を加えるやり方もありますが、少しザラッとした質感の画面になります。作品によってはフィルム的質感を狙って、こうした効果を強めに入れる場合もあります。

色の話題と言えば、現在のアニメーションの現場では、ほとんど24ビットカラーで作業しています。これは一般に言われるフルカラー1670万色にあたります。色の3原色RGBそれぞれに、8ビット256階調を割り当てて、256の3乗で1677万7216色を表示します(残りの8ビットはマスク用です)。AfterEffectsやPhotoshopでは8ビットカラーとチャンネルごとの値で表しています。セルや背景などもこの色数の中で作成されています。ただし撮影時にはさらに多いRGB各16ビットで計算を行います。これによって各チャンネル6万5536階調を使用できるのですが、AfterEffectsやPhotoshopは15ビットで処理するので、実際には3万2768階調になります。広い階調で計算することでグラデーションやボケを滑らかに表現することができます。8ビットしか使えなかった時代には、グラデーションの階調不足から、トーンジャンプと言って明るさが急激に変化して見える現象や、マッハバンドという一種の錯視による階調の境界が強調されて見える現象が起きたのですが、最近はだいぶ緩和されています。とはいえ、TVの場合は最終的に8ビットの画像として描き出す事が多いために、表現に階調が必要な暗部には特に注意が必要です。階調不足を軽減する方法としてはノイズや拡散を加えるやり方もありますが、少しザラッとした質感の画面になります。作品によってはフィルム的質感を狙って、こうした効果を強めに入れる場合もあります。

色に関しては、いろいろと決め事や注意事項があります。まずはモニターの色温度を設定する必要があります。写真などで言うホワイトバランスと同じですが、色温度で「白」に感じる色味が決まります。色温度はK(ケルビン)という単位で表しますが、高いと青白く、低いと赤っぽくなります。モニターの色温度が変わると表示される色が変わるので、画像データの色が変わったように感じますが、画像データのRGBの値が変わった訳ではなく、モニター上の表示が変わるだけです。パソコンモニターの標準は6500Kという値になっていますが、機械的な調整やソフトによる調整が可能です。TV作品であれば、日本のTVは9300Kというかなり青白く感じる値が基準なので、それに合わせます。誤った色温度のモニターで作業すると、せっかく作った色調もTV上で再現されない事になります。版権など紙がベースの場合は、印刷の基準である5000Kというかなり赤っぽく感じる値に設定すると正しい色調になります。

色温度にからめて言えば、皆さんのご家庭の視聴環境によっても見え方がだいぶ変わってしまいます。先ほど書いたように日本の家庭用TVは9300Kに調整されていますが、もちろん変更可能です。またそれとは別に画質を調整するモードがあり、通常売られている状態のTVはダイナミックモードというモードになっているものがほとんどです。これはコントラストが強く色調が派手に補正されるので見栄えはクッキリしますが、細かなニュアンスや微妙な色調が飛んでしまいます。連載の始めの頃に書きましたが、現場では業務用のフラットな画質のモニターを用いて確認していますので、オリジナルに近い色調や画質で楽しみたい場合は画質調整する事をお勧めします。制作側の意図がより伝わるのではないでしょうか。最近はアニメモードという専用のモードを搭載したTVやレコーダーもありますが、味つけはメーカーそれぞれですので、好みにあわせて色々試されるとよいかもしれません。

色では、カラースペースにも注意が必要です。モニター上にRGBで表現される色にはカラースペースと呼ばれるモニターに表示する色の範囲についての基準があります。現在はパソコンでも使われるsRGBやHDTVに合わせたRec.709などが主に使用されているようです。これらの基準に全ての作業用のモニターの設定を合わせられればトラブルを未然に防ぐことができます。理想を言えば、美術、色指定、撮影と色に関する部署では統一することが望まれますが、廉価なモニターでは調整機能がないものもあり、現実的には難しい状況です。

使用しているカラースペースとスキャナーやモニター、デジカメなど設定や特性の違う機材を通して見える色の違いを合わせるカラープロファイルという仕組みもあります。ただ、それも設定を誤るとデータ自体の色が変わってしまうことがあります。スキャン時やPhotoshop上で画像を作成したときにこのプロファイルを埋め込むことができるのですが、違うプロファイル設定がされた他のパソコンで開いた場合、同じ見た目になるように色が変換されてしまうのです。プロファイルの仕組みが導入された頃に、この事情を知らずに色が変わってしまう事故がいくつか起きました。微妙な差ですと、そのまま気づかずに素材が現場に流れてしまいます。もちろん、開くときにプロファイル変換するか無視するかのダイアログも出ますし、あらかじめ環境設定しておけば間違いも起きにくくなります。

ここまで8回に渡って撮影に関するアレコレを書いてきましたが、いかがだったでしょうか。これだけの分量の文章を、しかも人様に読ませるために書いたのは人生でも初めての経験でしたので、至らない部分も多々あったとは思いますが、そこはご容赦ください。内容も自分の観測範囲内や知人の仕事から見聞きしたものをまとめたもので、現場ごと作品ごとに異なる点もあるかと思います。現場は生き物で事情は刻々と変わり、新しい表現も日々生まれているからです。それでも、このコラムを読んでくれた皆さんが今後アニメを鑑賞する時、より深く作品を理解する助けに少しでもなっていれば幸いです。

最後に「撮影とはなんぞや」という事について、私感を少し述べたいと思います。以前にとある同人誌からインタビューを受けた時に、モノポリーみたいなもの、と喩えました。リソースを食いつぶしながら同じところを延々とぐるぐる回り続ける、けれども止まるコマはいつも全部違う、という意味です。今でも基本的には同じ考えですが、もう一つ、自分自身とじっくり向き合う時間でもあるなと思うようになりました。素材は全て他の人達が描いたり作ったりしたものですが、それらを統合してよりよい映像に仕上がるかは、他ならぬ自分の作業如何で決まります。ここで何ができるのか、逃げていないか、諦めていないか、まだできることはないか――いつも自問自答する時間(そんなに残り時間があるわけじゃないですが……)。そんな中で思わぬ発見をすることもあります。それもまた撮影という仕事の魅力なのかもしれません。

最後までお付き合いいただきありがとうございました。